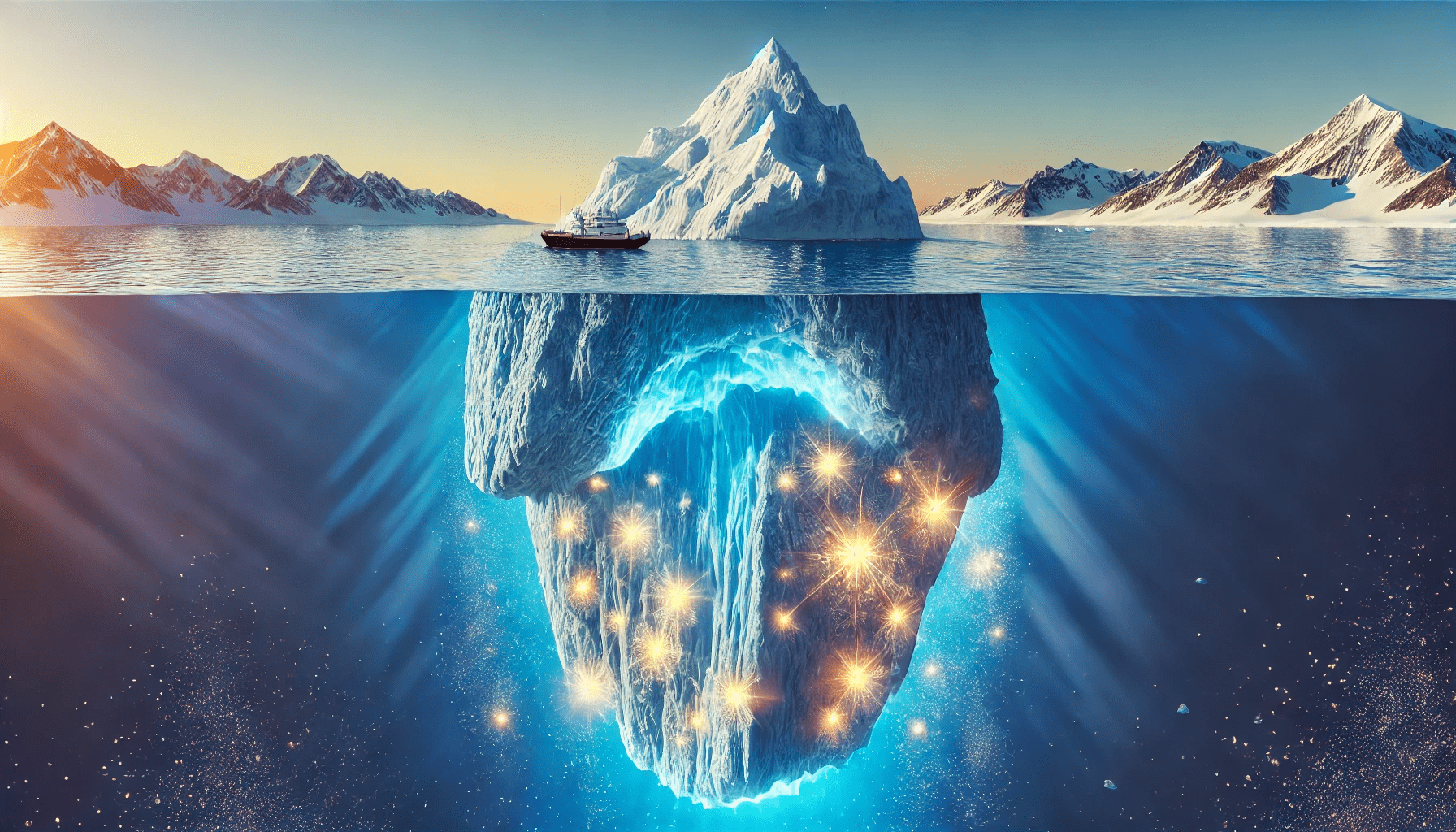

La conoscenza tacita, notoriamente concettualizzata da Michael Polanyi, si riferisce alla comprensione intuitiva e basata sull’esperienza che è difficile articolare o formalizzare. È il tipo di conoscenza su cui facciamo affidamento quando svolgiamo, senza riflettere, attività complesse come andare in bicicletta o socializzare. In questi casi il comportamento adottato è difficilmente riducibile a una lista di istruzioni e dipende piuttosto dall’intuizione delle azioni appropriate, le quali rispondono a indizi sensibili difficilmente esplicitatili. A differenza delle informazioni fattuali, la conoscenza tacita non può essere semplicemente scritta o trasmessa attraverso lezioni frontali. Costituisce un patrimonio culturale e personale di pratiche che permettono di navigare in contesti complessi attraverso la selezione inconscia dei segnali da prendere in conto così come delle reazioni possibili. Nonostante la prevalenza dell’intelligenza artificiale, dell’automazione e dell’apprendimento automatico, la conoscenza tacita è ancora una fonte significativa di intuizione e creatività umana che l’intelligenza artificiale fa estremamente fatica a riprodurre. L’intuizione e il sentimento ci guidano quando dobbiamo prendere decisioni in situazioni incerte, quando le informazioni disponibili non sono sufficienti per determinare oggettivamente lo stato dell’oggetto con cui si deve interagire. Ad esempio, un medico prende in considerazione un’ampia gamma di impressioni sul suo paziente per farsi un’idea della situazione prima di orientarlo verso lo specialista più indicato ; un insegnante comprende le ragioni delle difficoltà di un alunno facendosi un’idea del tipo di disagio che le causa; un investitore ha il sentore che una start-up sia più promettente di un’altra e un reclutatore che il candidato possa integrarsi più o meno bene nell’equipe. Benché di solito queste impressioni siano corrette, esse risultano nella più parte dei casi impossibili da giustificare attraverso degli argomenti razionali o comunicabili. Normalmente non è la lista di istruzioni fomite da un certo esperto che permette di acquisire la conoscenza tacita, ma l’osservazione e, soprattutto, l’esperienza.

Un network di neuroni artificiali può arrivare a delle conclusioni simili a quelle che gli umani tirano grazie alla conoscenza tacita, tuttavia tale risultato deriva da un’analisi estensiva di dati come da una serie impressionante di calcoli. Se l’intelligenza artificiale manca dell’intuitività orienta molte delle nostre pratiche, è anche vero che, dal punto di vista umano, le decisioni originate dai processi di deep learning non possono essere spiegate e appaiono come il risultato di quella che potremmo chiamare “conoscenza tacita artificiale”. Incapaci di ricostruire il numero esorbitante di operazioni che conducono dall’esplorazione dei dati alla costituzione di un modello adatto alla risoluzione di un problema, le decisioni dell’intelligenza artificiale si manifestano come la conseguenza di un sapere incomunicabile, di un ragionamento opaco. Per esempio, il network di neuroni artificiali AlphaGo è stato costruito con lo scopo di imparare a destreggiarsi nel go, un gioco che si fonda in gran parte sulla conoscenza tacita. Non potendo fornire al sistema una lista di istruzioni, gli sviluppatori lo hanno lasciato esplorare i dati relativi perché elaborasse autonomamente un modello e una pratica. Nel 2016 AlphaGo ha battuto il campione mondiale Lee Se-dol esibendo una serie di strategie originali e inspiegabili, come si fosse effettivamente creato un sapere implicito proprio e “alieno”. Il deep learning permette quindi all’intelligenza artificiale di creare dei modelli predittivi in maniera autonoma attraverso un processo che resta per noi tanto opaco quanto quello che conduce gli umani risolvere intuitivamente e rapidamente problemi la cui complessità richiederebbe dei calcoli espliciti estremamente laboriosi.

Quella che potremmo chiamare “conoscenza tacita artificiale” ha un impatto sulla conoscenza tacita degli umani. In maniera sempre più estensiva, infatti, ricorriamo ai sistemi basati sul deep learning per valutare le decisioni da prendere, soprattutto in contesti poco familiari, quando non disponiamo di intuizioni affidabili. Per esempio, gli investitori ricorrono alle previsioni dei modelli creati dall’intelligenza artificiale per valutare il rischio legato a determinate azioni; un’insegnante può tenere in conto le estimazioni degli algoritmi per rispondere alle esigenze individuali di uno studente; i medici consultano le diagnosi prodotte dai sistemi dedicati e le candidature di lavoro sono sempre più spesso scremate da programmi appositi. Le valutazioni prodotte con la tecnica del deep learning, e quindi basate su processo opaco, entrano a far parte del patrimonio delle conoscenze tacite umane, in particolare quando impariamo a riconoscere dei pattern utili prima ignorati. L’interazione con sistemi basati sull’intelligenza artificiale fa quindi emerger uno nuovo tipo di conoscenza tacita ibrida. Se l’intelligenza artificiale impara fornire dei risultati simili a quelli prodotti dall’intuizione umana osservando nostro comportamento, anche gli umani imparano dagli algoritmi arricchendo il patrimonio del loro sapere implicito. In questo senso la collaborazione con i sistemi basati sul deep learning si rivela fruttuosa in quanto permette di allagare e rielaborare il patrimonio comune della conoscenza tacita.

Tuttavia, la sempre più stretta collaborazione con l’intelligenza artificiale comporta anche dei rischi. In vari casi, infatti, le ipotesi prodotte attraverso l’esplorazione dei dati sono basate su correlazioni che favoriscono ingiustamente determinati gruppi sociali alle spese di altri. È il caso dei famosi bias che contribuiscono a rinforzare pregiudizi esistenti riproducendo le discriminazioni legate a quello che potremmo definire il versante negativo della conoscenza tacita umana. Spesso infatti, il nostro giudizio è legato a stereotipi inconsci che i dati forniti agli algoritmi riflettono compromettendo così la possibilità di ottenere delle valutazioni più obiettive che quelle che gli umani operano automaticamente. Per esempio, le candidature maschili possono essere privilegiate rispetto a quelle femminili perché un certo ruolo è stato occupato più frequentemente da uomini nel passato; l’insuccesso scolastico può essere un rischio attribuito a studenti provenienti da famiglie a basso reddito con l’effetto di suggerire corsi di studio che non valorizzano le competenze effettive; la probabilità di una certa patologia può essere sottovalutata in gruppi etnici che non hanno avuto accesso al sistema sanitario in precedenza. In altre parole, non sempre affidarsi all’intuito piuttosto che a un ragionamento comunicabile, del quale si può collettivamente discutere, porta a decisioni compatibili col senso tipicamente umano di giustizia. Di conseguenza, se uno dei vantaggi offerti dall’intelligenza artificiale è quello di ottenere delle estimazioni meno soggettive e parziali, non dobbiamo omettere di misurare il valore etico delle decisioni dei sistemi basati sul deep learning. Piuttosto che affidarsi ciecamente alle suggestioni degli algoritmi, è quindi consigliabile di verificare se sono compatibili col senso di giustizia che costituisce una delle più importanti conoscenze tacite nel repertorio umano: derogare a tale guida non può avere che delle conseguenze negative sul progresso del patrimonio della conoscenza tacita.