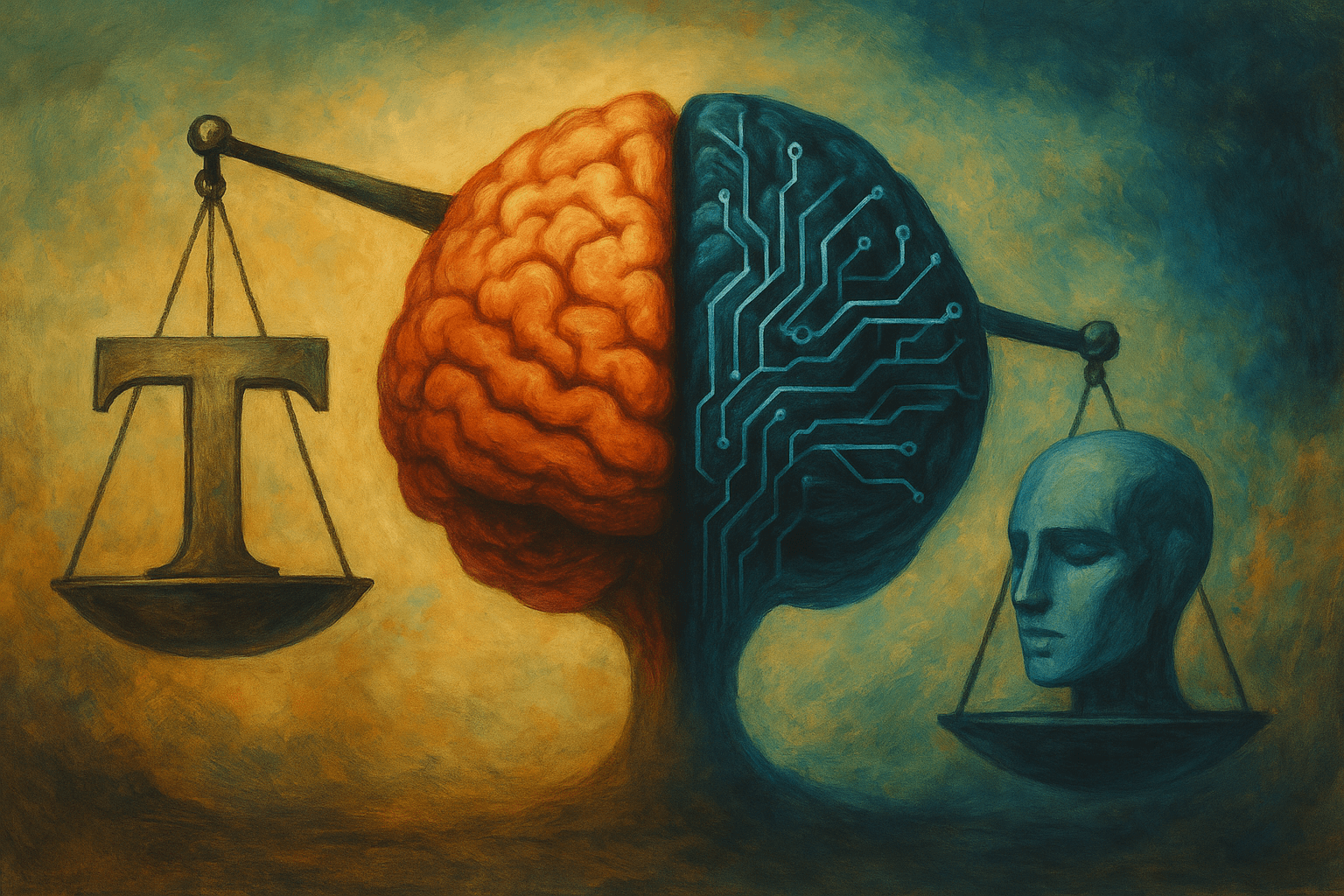

È stato recentemente evidenziato il fatto che la mitologia della rivoluzione digitale e dell’IA trascura di affrontare un punto delicato del nesso tra cibernetica e vita quotidiana:

“Il contesto sociale in cui l’Intelligenza Artificiale è inserita rende necessario prendere in considerazione anche gli effetti che una tecnologia esercita su ciò che sta a cuore a chi ne viene toccato, su ciò a cui si dà valore o che si ritiene degno di approvazione o di biasimo… A questo punto è chiaro perché abbiamo bisogno di un’indagine etica sull’Intelligenza Artificiale” 1.

Ma l’etica, o meglio la bioetica, dell’IA non può essere gestita, come sta accadendo negli ultimi tempi, dalle stesse Big Tech che progettano e sviluppano le piattaforme, i programmi e i device cibernetici che stanno invadendo ogni ambito della nostra vitae nel contempo perfino promuovono la concettualizzazione di un’etica dell’intelligenza artificiale (!) come strumento di controllo per garantire la neutralità e perfettibilità dei propri beni o servizi. Si tratta in realtà di uno “specchietto per le allodole” – come è stato definito 2 – contraddittorio e illusorio perché la cibernetica può solo produrre una “pseudo-etica” come sviluppa una “realtà virtuale” o una “intelligenza artificiale” che proprio in quanto “digitale” non deve mai sostituirsi al bio-etico.

Ecco perché la questione bioetica – una nuova concezione allargata oltre la dimensione antropomorfa fino all’intero contesto materiale, animale e digitale – deve rappresentare un cleavage, un confine che non si deve bypassare o aggirare. L’etica infatti deve andare oltre la vita stessa dei Sapiens e deve garantire e regolare l’intera coevoluzione dell’ambiente naturale e artificiale in cui viviamo. E ciò perché l’etica come la coscienza è un risultato bio-sociale elaborato nei secoli dell’evoluzione antropomorfa che abbiamo configurato come tratto essenziale del nostro percorso esistenziale.

L’intelligenza si può forse “imitare” o “surrogare” ma la bioetica no, perché è un connotato distintivo (anche se mutevole e imperfetto come tutte la qualità antropomorfe) della coevoluzione dei Sapiens che la cibernetica non può mai sostituire o manipolare. In questo senso l’etica, come la politica, come la coscienza e l’autonoesi sono tratti esclusivi della nostra specie proprio in quanto bio-sociali e bio-culturali, anche se mutano nel tempo – e a maggior ragione oggi – , ma mantengono sempre una dimensione identitaria che rende possibile, probabile e irrinunciabile il nostro stesso modo di esistere come Sapiens e non come Insipiens.

Perciò, lo sviluppo incontrollato dell’antropotecnica mediante la cyborgizzazione della vita bio-sociale si scontra sempre più con la centralità della “questione etica” che è e deve restare peculiarità della nostra specie. Al crescere incontrollato dei processi di informatizzazione nel percorso esistenziale sono emerse infatti alcune conseguenze negative e controproducenti: il deep learning dei processi di “intelligenza artificiale” spesso sono condizionati da bias, cioè da distorsioni e da pregiudizi che caratterizzano i dati utilizzati dai computer per elaborare programmi o favorire scelte o soluzioni informatizzate e ipostatizzate che sembrano asettiche quando invece non lo sono. E ciò perché dietro la nozione di bias si nasconde il vero problema di fondo: l’importanza della dimensione etica come concezione antitetica e alternativa rispetto all’automazione e perfezione algoritmica dell’IA.

Infatti, l’agency umana, come le sue teorie interpretative, ha sempre dovuto confrontarsi (a torto o a ragione, a seconda dei casi e dei contesti) con principi e valori etici elaborati nel corso dei secoli dai Sapiens medesimi per distinguere ciò che è buono da ciò che è cattivo, ciò che è giusto da ciò che è ingiusto, ciò che è alternativo ed emancipativo da ciò che è frutto di sottomissione ed omologazione, ciò che è meglio per tutti e non solo per alcuni, ciò che è morale da ciò che non lo è, e così via. Quindi l’etica, come la coscienza e l’autoriflessività, non può mai essere né accantonata né eliminata e soprattutto non surrogata dalla digitalizzazione. Infatti da più parti viene ormai stigmatizzato la centralità del problema etico:

“Se non elaboreremo migliori quadri normativi giuridici ed etici, l’IA creerà ulteriori polarizzazioni nella nostra società, specialmente tra i pochi al di sopra delle macchine – i nuovi patrizi – e coloro che stanno al di sotto di esse – la nuova plebe” 3.

Inoltre, come è stato apertamente denunciato:

“Giudizi e decisioni che hanno effetti rilevanti sulle vite di esseri umani sono oggi affidati… a sistemi di intelligenza artificiale che non funzionano. In settori quali quello giudiziario, dei servizi finanziari, dell’educazione, dei servizi sociali o del reclutamento del personale, l’uso dei sistemi di apprendimento automatico (machine learning) nei processi di valutazione e decisione ha dato luogo a esiti ingiusti, nocivi e assurdi” 4 .

E ciò perché l’IA e i suoi prodotti digitali non hanno alcuna percezione della rilevanza delle questioni etiche e valoriali in quanto perseguono un unico obiettivo “algoritmico”: efficienza, automatismo, neutralità, perfezione. Ma questi obiettivi, oltre che a essere discutibili per la loro “irrealtà”, sono fortemente influenzati – come abbiamo visto – proprio dai dati digitalizzati che alimentano il machine learning e l’elaborazione dei programmi, e sono quindi alla base dei risultati cibernetici che il sistema computerizzato costruisce. Di conseguenza, non c’è solo connessione ma anche contemporaneamente profilazione (per interessi economici e politici), non basta l’interattività ma ci vuole anche soprattutto l’autoreferenzialità (che non è mai algoritmica né matematica), inoltre la rapidità dei risultati non giustifica il feticismo binario (0, 1) della loro realizzazione, come la stessa felicità dei risultati non può diventare una droga virtuale, così come l’efficienza non può generare la mancanza di senso, e l’inclusione non deve portare mai alla standardizzazione. Queste sono alcune delle contraddizioni tipiche di una società priva di consapevolezza etica e morale.

Non si può dunque progettare, costruire e sviluppare una rivoluzione informatica senza tenere conto prioritariamente dell’etica che caratterizza – anche quando si evolve e si modifica – il pensiero e l’azione dei Sapiens medesimi. A questo proposito alcuni studiosi, come Quintarelli, hanno cercato di riformulare – anche in modo provocatorio – questo tema centrale individuando i diversi possibili ambiti di azione (e di critica):

“Computer Ethics: comprende riflessioni sulla responsabilità di programmatori e ingegneri informatici, analisi dell’impatto etico-sociale delle tecnologie informatiche… Roboetica: disciplina volta a promuovere la produzione di tecnologie benefiche e ad allineare l’ingegneria robotica a standard morali e sociali… Etica delle macchine: tentativo di dotare sistemi tecnologici della capacità di gestire in autonomia situazioni morali in modo soddisfacente… Etica dei dati: disciplina che si occupa di Identificare e discutere varie questioni etiche collegate alla raccolta di dati e alla loro analisi attraverso sistemi di machine learning”5.

Quindi, la questione bioetica deve rimanere una dimensione ineliminabile e ineludibile che serve a controllare (e smontare) gli esiti sbagliati dello stesso processo di digitalizzazione. A tal fine si potrebbe immaginare una nuova versione aggiornata della famosa Legge della Robotica di Asimov:

- Nessun algoritmo o device informatico deve accantonare o bypassare la questione bioetica come componente obbligatoria del funzionamento dell’IA.

- Pregiudizi, distorsioni, interessi settoriali e presunte neutralità non devono essere presenti nei data set forniti al computer per sviluppare il machine learning e il deep learning dell’IA.

- Ogni robot deve produrre benefici e impedire di causare danni ad ogni essere umano applicando sempre la bioetica e non solo la cibernetica.

1 Quintarelli, Stefano (a cura di), Intelligenza artificiale, Bollati Boringhieri, Torino 2020, p. 81.

2 Tafani, Daniela “L’etica dell’intelligenza artificiale? Perché è solo uno specchietto per le allodole”, Agenda Digitale, 2023.

3 Floridi, Luciano, Etica dell’intelligenza artificiale, Raffaello Cortina, Milano 2022, p. 337.

4 Tafani, Daniela, op. cit. p. 1.

5 Quintarelli, Stefano, op. cit. p. 82.

Immagini generate tramite ChatGPT. Tutti i diritti sono riservati. Università di Torino (2025).