Nel 2012, la città di Chicago ha adottato un sistema di polizia predittiva chiamato PredPol. Il funzionamento è apparentemente semplice: l’algoritmo analizza i dati storici sui crimini — tipologia, luogo, orario — e produce mappe di “calore” che indicano alle pattuglie dove concentrarsi. Strumento neutro, efficiente, scientifico. Eppure, a distanza di anni, le comunità di colore nelle zone presidiate hanno denunciato qualcosa di paradossale: più agenti venivano inviati nelle loro strade, più crimini venivano rilevati, e più l’algoritmo tornava a indicare quelle stesse strade come pericolose. Un cerchio che si chiude su sé stesso — e che schiaccia.

Questo articolo vuole mostrare che quel cerchio non è un semplice errore tecnico correggibile con dati migliori. È una forma di ingiustizia epistemica strutturale, nel senso preciso che la filosofia analitica ha elaborato nel corso degli ultimi vent’anni.

Il problema del credibility excess

Il concetto di ingiustizia epistemica è stato sviluppato in modo sistematico da Miranda Fricker, ma è Jennifer Lackey ad averne individuato una variante particolarmente insidiosa: il credibility excess. Lackey la analizza nel contesto delle false confessioni nel sistema giudiziario americano: le confessioni ricevono una credibilità sproporzionata rispetto alle ritrattazioni successive, anche quando queste ultime sono supportate da prove. Il problema non è la mancanza di credibilità delle vittime, ma l’eccesso di credibilità attribuito a un certo tipo di testimonianza — quella che conferma ciò che il sistema si aspetta di sentire.

Applicare questa categoria all’intelligenza artificiale significa chiedersi: chi — o cosa — gode di credibilità epistemica sproporzionata nel processo decisionale contemporaneo? La risposta, sempre più spesso, è il sistema algoritmico. E non perché l’algoritmo “parli” nel senso ordinario del termine, ma perché le sue valutazioni vengono trattate come se fossero neutrali, oggettive, superiori alla percezione umana. L’output dell’algoritmo non è un punto di vista tra molti: è un fatto.

Il loop che si auto-alimenta

Nel caso della polizia predittiva, il credibility excess produce un meccanismo che la filosofa Renée Jorgensen ha descritto come data redundancy: un loop di ridondanza dei dati che non riflette la realtà criminale di un territorio, ma la propria storia di sorveglianza.

Il funzionamento è il seguente. L’algoritmo analizza i crimini registrati in un’area e suggerisce un aumento della presenza poliziesca. Più polizia significa più controlli, più fermi, più denunce. Questi nuovi dati entrano nel sistema e confermano la stima iniziale. L’area viene classificata come ad alto rischio non perché lo sia oggettivamente, ma perché è stata trattata come tale. Il sistema impara da sé stesso. Le conseguenze non sono distribuite in modo neutro. Le comunità che finiscono nel mirino dell’algoritmo sono quasi invariabilmente quelle già marginalizzate: povere, di colore, storicamente sotto-rappresentate nelle istituzioni. La ridondanza dei dati è, in altri termini, la codificazione algoritmica di pregiudizi già esistenti. Non li crea dal niente: li amplifica, li istituzionalizza, li rende quasi inattaccabili.

Le voci che vengono messe a tacere

È qui che entra il contributo di José Medina. Nel suo lavoro sull’ingiustizia epistemica agentiva nel sistema penale americano, Medina distingue quattro forme attraverso cui le voci dei soggetti marginalizzati vengono sistematicamente neutralizzate. Due di queste forme sono particolarmente illuminanti per il caso che stiamo analizzando.

La prima è il silencing illocutorio: una comunicazione che, pur avvenendo formalmente, viene privata della sua forza. Una denuncia viene raccolta, ma non ha effetto. Un’obiezione viene registrata, ma non modifica il processo decisionale. Nel contesto della polizia predittiva, il silencing illocutorio si produce ogni volta che la segnalazione di un abitante — “questa zona non è pericolosa come l’algoritmo dice” — viene ascoltata ma non pesa. Il sistema non confuta la testimonianza: semplicemente non la conta.

La seconda forma è il silencing perlocutorio: non si tratta di una comunicazione che viene ignorata, ma di una comunicazione che non avviene nemmeno. Chi vive in un’area sovra- presidiata impara, nel tempo, che parlare con le autorità è inutile o controproducente. La paura di essere malinterpretati, di diventare a propria volta oggetto di attenzione, produce un’autocensura sistematica. Le persone smettono di segnalare reati minori, smettono di interagire con le forze dell’ordine, smettono di esistere come testimoni. Il silenzio non è libero: è imposto.

In entrambi i casi, l’algoritmo non è la causa prima dell’ingiustizia — ma ne è il moltiplicatore. La credibilità di cui gode trasforma un pregiudizio correggibile in una struttura che si autoconferma.

Un’uscita possibile: l’attivismo epistemico

Medina stesso propone una risposta a queste dinamiche: l’epistemic activism, l’attivismo epistemico. L’idea è che le ingiustizie di questo tipo — quelle che non riguardano solo i diritti formali, ma la capacità di essere ascoltati come agenti conoscitivi — richiedano forme di resistenza collettiva e organizzata. Non basta rivendicare l’accesso alla giustizia: bisogna rivendicare il diritto di contribuire alla costruzione della conoscenza che quella giustizia alimenta.

Tradotto nel contesto algoritmico, questo significa costruire piattaforme in cui le comunità colpite possano non solo ricevere informazioni sui sistemi che le riguardano, ma partecipare attivamente alla loro valutazione e critica. Significa formare comitati di supervisione che includano i residenti delle aree presidiate, i rappresentanti delle organizzazioni civili, gli esperti indipendenti. Significa pretendere che la trasparenza degli algoritmi non sia solo un documento tecnico accessibile agli specialisti, ma un processo comprensibile e contestabile da tutti.

Questa proposta non è priva di ostacoli. Le resistenze istituzionali sono reali, le risorse necessarie sono spesso assenti, e le asimmetrie di potere che l’attivismo epistemico vuole correggere sono le stesse che ne rendono difficile l’attuazione. Ma la sua logica è corretta: se il problema è la concentrazione di credibilità epistemica in un sistema chiuso, la soluzione non può che passare per la sua redistribuzione.

La polizia predittiva non è un caso limite. È un esempio particolarmente visibile di una tendenza più ampia: quella di delegare decisioni ad alto impatto a sistemi algoritmici, e di attribuire a questi sistemi una credibilità che nessuna voce umana può facilmente scalfire. Quando l’algoritmo ha sempre ragione, non è perché abbia ragione: è perché abbiamo smesso di chiederci chi ha torto.

Riconoscere le forme attraverso cui questa dinamica produce ingiustizia epistemica è il primo passo per contrastarla. E forse il passo più urgente.

Riferimenti bibliografici

Fricker, Miranda. Epistemic Injustice: Power and the Ethics of Knowing. Oxford University Press, 2007.

Jorgensen, Renée. “Algorithms and the Individual in Criminal Law.” Canadian Journal of Philosophy 52, no. 1 (2022): 61–77.

Lackey, Jennifer. “False Confessions and Testimonial Injustice.” Journal of Criminal Law and Criminology 110, no. 1 (2020): 43–82.

Medina, José. “Agential Epistemic Injustice and Collective Epistemic Resistance in the Criminal Justice System.” Social Epistemology 35, no. 2 (2021): 185–96.

Perrot, Patrick. “What about AI in criminal intelligence? From predictive policing to AI perspectives.” European Police Science and Research Bulletin 16 (2017): 65– 76.

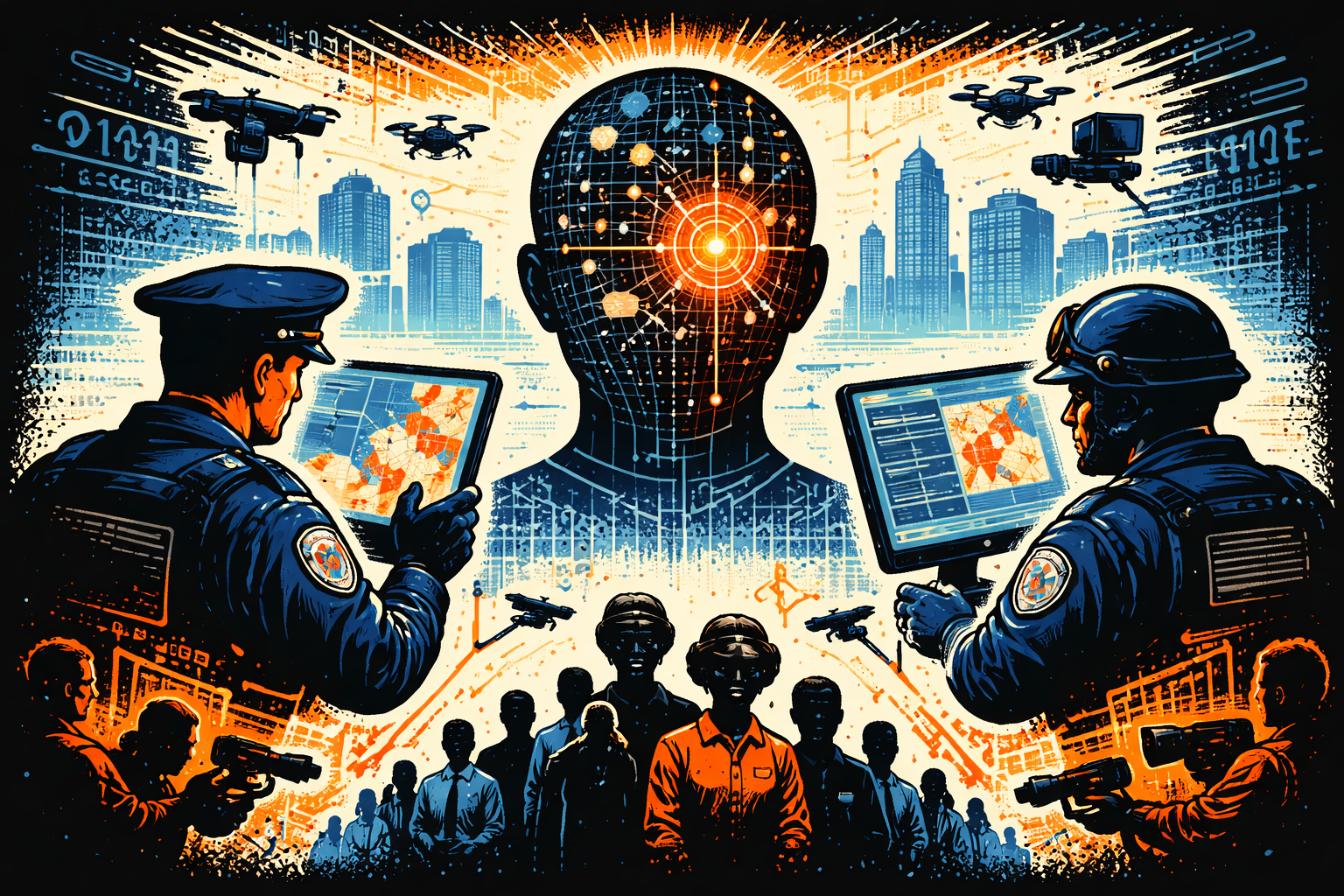

Immagini generate tramite ChatGPT. Tutti i diritti sono riservati. Università di Torino (2026).