Le differenze umane nel giudizio, frutto dell’unicità e singolarità di ogni individuo, creano rumore nei sistemi di intelligenza artificiale, complicando l’eliminazione dei bias. Questo concetto, analizzato dal premio Nobel Daniel Kahneman, si rivela cruciale non solo nei contesti legali e medici, ma anche nel funzionamento dell’IA.

Il rumore, definito come la variazione nei giudizi su uno stesso problema, si manifesta in modo preoccupante anche in ambiti apparentemente oggettivi come le decisioni giudiziarie e le valutazioni assicurative. Questo fenomeno è rilevante anche per l’IA, che si confronta con dati etichettati da umani, come nel caso di modelli di linguaggio tipo ChatGPT.

I ricercatori hanno dimostrato che il rumore influisce significativamente sui risultati, anche nei test di buon senso. Kahneman ha proposto “audit del rumore” per quantificare e mitigare questo problema, un approccio che i ricercatori di IA sono incoraggiati a adottare, analogamente agli audit per il bias.

Leggi l’articolo completo: ‘Noise’ in the machine: Human differences in judgment lead to problems for AI su theconversation.com.

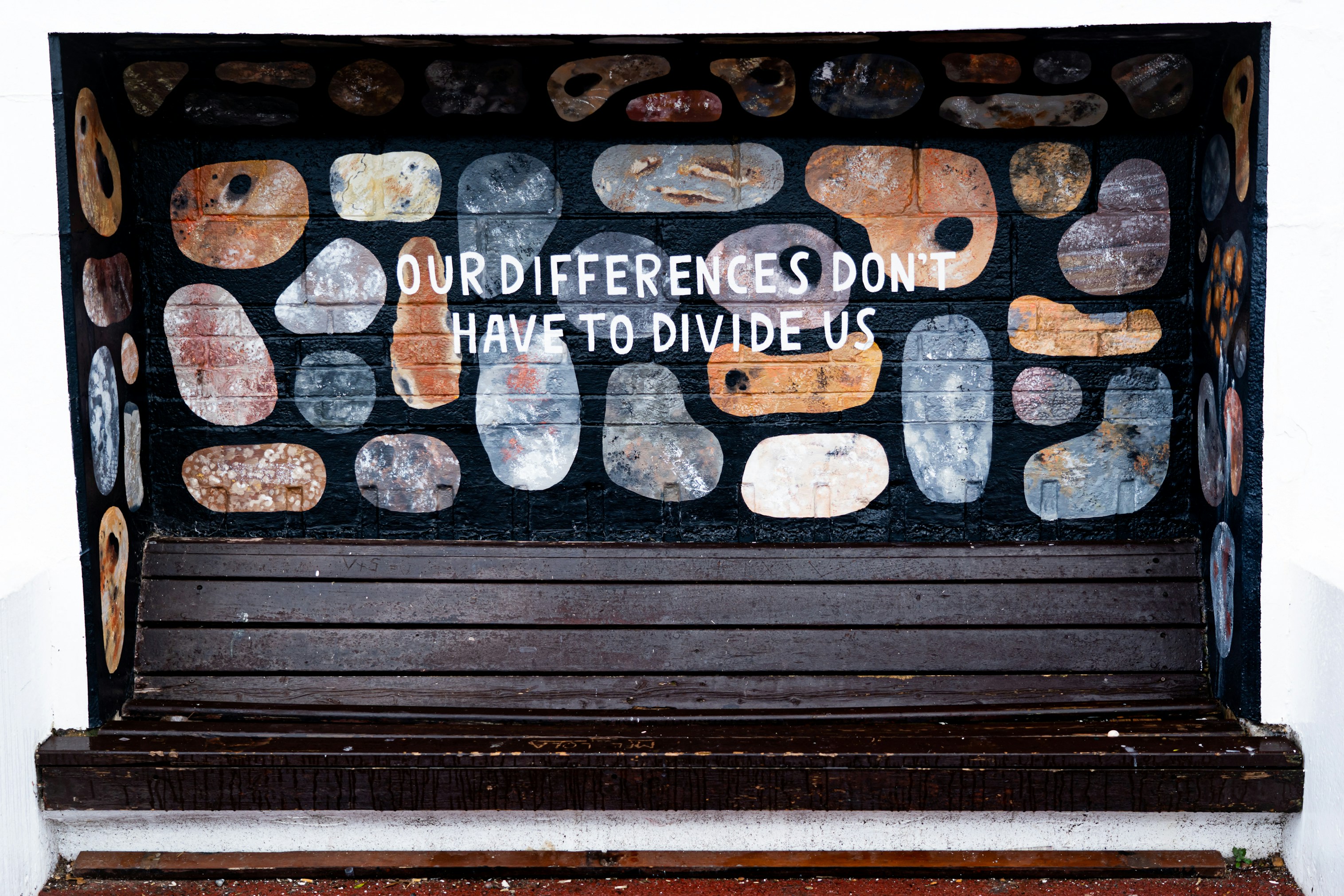

Foto di Nick Fewings su Unsplash.