1. Le forme della verità

Viviamo in un tempo in cui la parola “verità” ha perso la sua unicità. Se per secoli si è identificata con la corrispondenza tra pensiero e realtà (veritas est adaequatio rei et intellectus), la filosofia del Novecento ha mostrato come ogni verità implichi un atto interpretativo. Luigi Pareyson, in “Verità e interpretazione” (1971), ha articolato questo passaggio con finezza: la verità non è un dato, ma un processo; non si possiede, si cerca; emerge nel confronto tra soggetto e oggetto, mai chiusa, mai definitiva. Hans-Georg Gadamer, in “Verità e metodo” (1960), ha sottolineato la dimensione storica e dialogica dell’interpretazione: la verità si radica nella tradizione e si dispiega nel linguaggio, in un processo continuo di comprensione reciproca. A questa doppia visione – verità come corrispondenza e come interpretazione – si affianca da sempre una terza: la verità come rivelazione. Qui il pensiero si arresta di fronte a qualcosa che si mostra, si impone, si dona: non costruzione, ma evento. Heidegger ha chiamato questo svelamento “aletheia”, dischiudimento dell’essere. La verità, in questa prospettiva, non si costruisce né si deduce: accade, sorprende, chiama.

2. La nascita della verità come configurazione

Oggi, l’intelligenza artificiale sembra inaugurare una quarta figura della verità: quella della configurazione. Non più solo corrispondenza ai dati, né pura interpretazione, né disvelamento trascendente: ma produzione di risultati operativi interni a un modello. Ciò che è vero non è ciò che è reale, né ciò che è sensato, ma ciò che è computazionalmente plausibile. L’algoritmo non dice il vero perché coglie il significato o lo rivela: è vero perché funziona, predice, genera.

Questa trasformazione ha implicazioni profonde. Non è solo una questione tecnica, ma una svolta epistemologica. Nello Cristianini, in “La scorciatoia” (2023), ha descritto il passaggio da una conoscenza causale a una conoscenza per correlazioni, in cui si rinuncia a spiegare per prevedere. Daniel Andler, in “Il duplice enigma. Intelligenza artificiale e intelligenza umana” (2021), mostra come l’IA operi senza accedere al significato, generando risultati – o verità configurate – che non hanno bisogno di giustificazione teorica. La verità, intesa come configurazione, è performativa, non giustificata: non richiede una teoria, ma una coerenza interna al sistema. Esito di una rete neurale, non di una logica deduttiva o di un evento di senso.

Questa trasformazione epistemica ha un precedente inquietante e visionario in letteratura: Franz Kafka l’aveva già messa in scena, ben prima dell’avvento degli algoritmi.

3. Kafka e la verità automatica

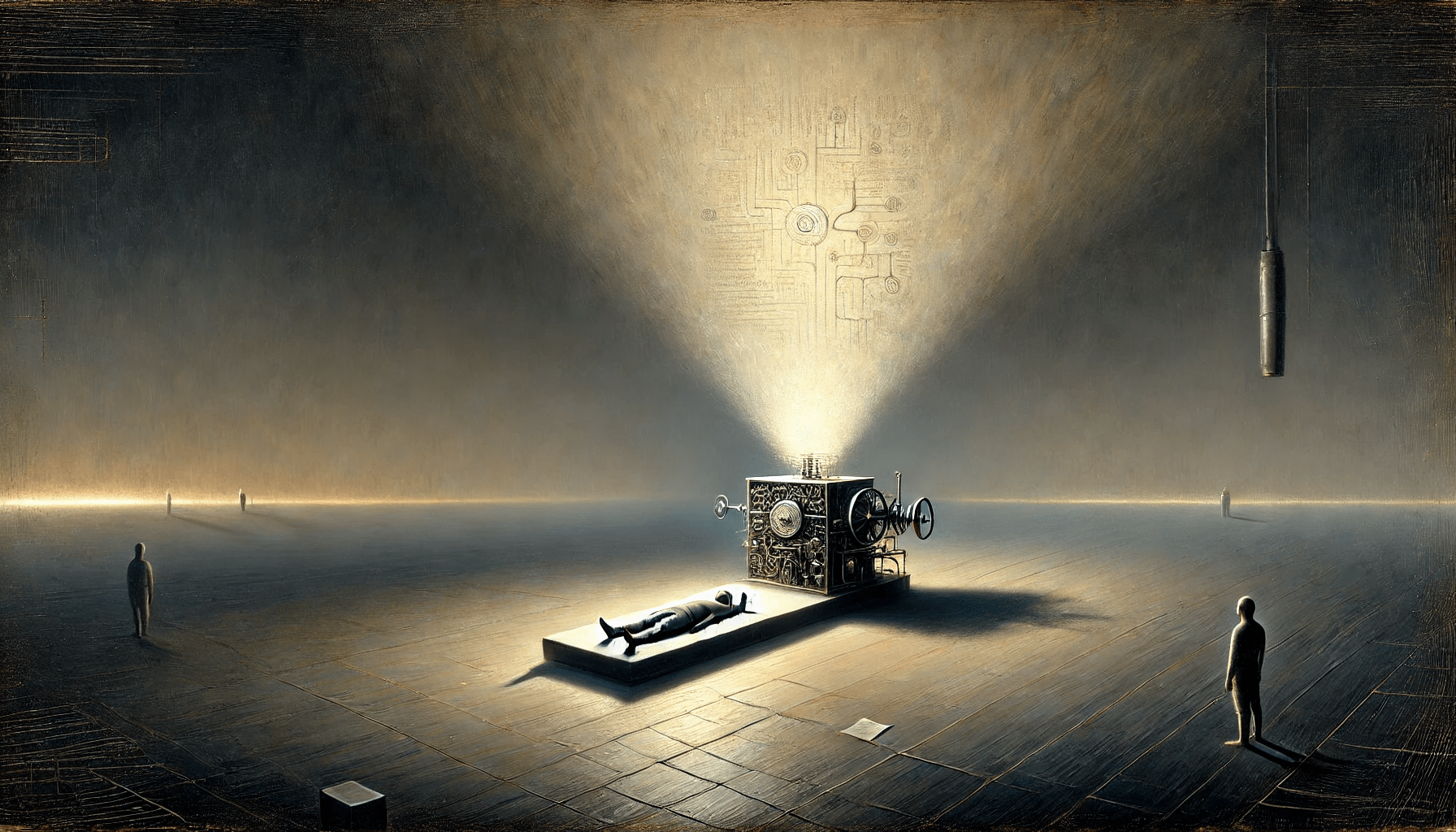

Franz Kafka, con la sua consueta precisione simbolica, ha offerto un’immagine profetica di questa deriva nel racconto “Nella colonia penale” (“In der Strafkolonie”, 1919). Un ufficiale invita un osservatore esterno ad assistere a un’esecuzione esemplare. Il condannato non conosce l’accusa, non ha avuto processo: la macchina esegue la sentenza incidendo sul suo corpo la legge violata. Il gesto non è punitivo, è rivelatorio: la verità della colpa si scrive nella carne. Non c’è appello, né comprensione: solo l’esecuzione. La macchina è giudice e verità insieme. E quando l’ufficiale si offre volontario per dimostrarne la giustezza, la macchina si inceppa. Incide, ma a vuoto. La verità si riduce a segno senza senso, a configurazione senza rivelazione.

4. Algoritmi e senso

Questa macchina kafkiana prefigura il funzionamento degli algoritmi odierni. Anch’essi operano senza comprendere: elaborano correlazioni, non cause; pattern, non concetti. Come la macchina penale, producono esiti senza giustificazione. Ciò che conta non è perché qualcosa sia così, ma che venga predetto in modo accurato. Luciano Floridi, in “The Ethics of Information” (2013), ha parlato di “opacità epistemica” per indicare la difficoltà di comprendere e giustificare i risultati di un sistema. Il sapere si fa esecutivo, il pensiero si ritrae.

Nel racconto, l’osservatore si limita a guardare. Non approva, ma non interviene. Questa postura ambigua richiama il nostro presente: siamo testimoni di un cambiamento radicale, ma restiamo ai margini, tra fascinazione e sospetto. La verità algoritmica non interpella, non si discute: si accetta.

5. La deriva della verità performativa

Il rischio è la sostituzione del giudizio con l’esito, dell’interpretazione con l’output, della rivelazione con la generazione. Laddove la verità come rivelazione implicava una passività attenta, un’apertura all’evento, qui abbiamo una passività tecnica: ciò che l’algoritmo produce viene assunto come vero perché conforme al modello. La libertà interpretativa si affievolisce. La verità diventa ciò che è generato senza errore, non ciò che interroga, espone, apre.

Questo cambiamento incide anche sul piano etico: l’esplicabilità (explainability), principio fondamentale per la responsabilità nell’uso dell’IA, rischia di essere svuotata se il sistema è accettato solo in virtù della sua efficienza. La verità performativa si impone non perché giusta, ma perché efficace.

6. Quale verità ci resta?

In questo contesto, la figura della verità come configurazione mostra tutta la sua ambivalenza. Da un lato, consente una potenza predittiva mai vista; dall’altro, rischia di addestrarci a una verità senza senso, a un sapere senza pensiero. L’umano, da soggetto della verità, rischia di diventare terminale di una verità prefigurata.

Ripensare oggi la verità significa allora riconoscere la pluralità delle sue forme: la verità come corrispondenza, come interpretazione, come rivelazione e, ora, come configurazione. Ma soprattutto significa riaffermare la centralità del gesto interpretativo, della libertà che ascolta, accoglie, contesta. La macchina non può sostituire questo spazio. Può produrre, non comprendere. Può generare, non rivelare.

Tuttavia, alcune riflessioni recenti aprono scenari inaspettati. Guido Boella ha proposto che i modelli linguistici generativi, come i LLM, possano modellare forme di conoscenza tacita, quella dimensione del sapere che Michael Polanyi (“The Tacit Dimension” 1966) ha descritto come implicita, non formalizzabile, ma decisiva per ogni scoperta autentica. Se questo è vero, ci troveremmo di fronte a una paradossale rivelazione senza soggetto: non un disvelamento esperienziale, ma l’emergere di connessioni inedite attraverso un sistema addestrato a riconoscere pattern al di là delle regole esplicite. Una simulazione di insight che, pur non vissuta, potrebbe sorprendere per coerenza o efficacia. Resta tuttavia aperta la domanda essenziale: può esistere rivelazione senza esperienza? È sufficiente generare l’effetto di un’intuizione perché si possa parlare, anche in senso lato, di verità?

Kafka ci ha lasciato una parabola chiara. Laddove la verità si riduce a procedura, a performance, essa perde il legame con la giustizia, con il senso, con la parola. La sua macchina non è solo crudele: è cieca. E se oggi le nostre macchine ci offrono verità sempre più plausibili, il compito del pensiero resta quello di chiedersi se siano anche vere. Non nel senso dell’efficienza, ma nel senso del senso.

Forse lì si gioca la posta dell’umano nell’età dell’Intelligenza Artificiale.

Immagine generata tramite DALL-E. Tutti i diritti sono riservati. Università di Torino (2025).